潮声丨AI伪造泛滥真实何去何从?

刘健建议,要从源头管理★、信息传播链路的监控以及防控机制的建立三个维度出发★,构建全面且细致的法制框架,做到有法可依★、有据可查,并且不应仅限于事后处理,而应在事前建立机制,通过提高违法成本★,形成强大的震慑力★,从源头上遏制风险★。

蚂蚁集团AI核身安全负责人刘健告诉记者★,AI的终极目标是模拟真实世界,其模拟物理和生物信息的能力会变得越来越强大,一些定制化的诈骗更是让人防不胜防。

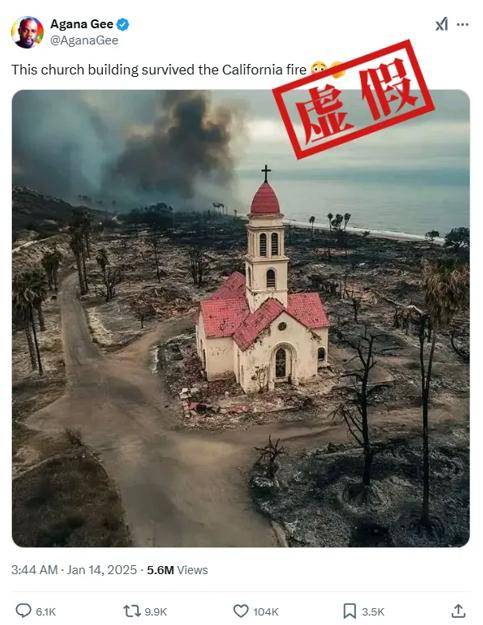

暴力冲突、灾难现场、阶层矛盾★、性别对立等社会热点议题,往往成为AI假新闻的重灾区★。

俗话说“造谣一张嘴★,辟谣跑断腿”。若要验证一条新闻的真实性★,公检法部门★、媒体等需要调动大量资源★,被造谣者则往往会陷入无尽的自证陷阱★。等到一切水落石出,假新闻早已环游世界,“吃饱”流量,赚得盆满钵满。

刘健将肉眼识别AI伪造比作“找茬游戏★”。他指出,★“比如生物学上的不合理之处,地震小男孩有六个手指这种细节,或是光影效果不符合物理学原理。” 所有图像由像素组成,质感异常也是线索之一★。普通人可以关注图像精细化细节、生物合理性及物理特性,利用这些线索辨别虚假信息,增强鉴别能力★,应对复杂的AI伪造挑战。这样,公众可以更好地保护自己免受虚假信息的影响。

目前,王永威团队已经推动了部分技术应用落地★,如高校论文鉴伪、内容审核等★,未来还将向更多领域拓展。

比如2024年香港一家公司财务被AI仿造的“高管★”通过视频会议骗取2亿港元★,这是一个定制化的AI诈骗局,除了本人,整个视频会议参与者全是骗子★。在他研究的案例中,还有AI换脸伪造成家人、同事电信诈骗,伪造电子身份凭证线上交易,利用AI技术伪造活体视频突破认证等等。

★“AI大模型是一把双刃剑,如何用好它取决于使用者的意图与行为★。”陶沁沁呼吁,AI安全的守护是一项系统工程,需要政府★、企业、公众等多方面的共同努力与智慧碰撞。在这场没有硝烟的战争中,每一方都是不可或缺的战士★,共同编织着一张守护数字时代安全的密网★。

守护AI向善,不仅仅需要企业在应用层面设好防火墙,还需要更多高校、科研院所以及更多社会力量的加入,以提升行业的整体水平。

王永威告诉记者,自2018年起★,AI伪造现象便逐渐显现★,而时至今日,AI模拟真实世界的能力已显著提升。★“从文本到图像★、视频,技术的每一次飞跃都伴随着生产力的提升与犯罪成本的降低。”

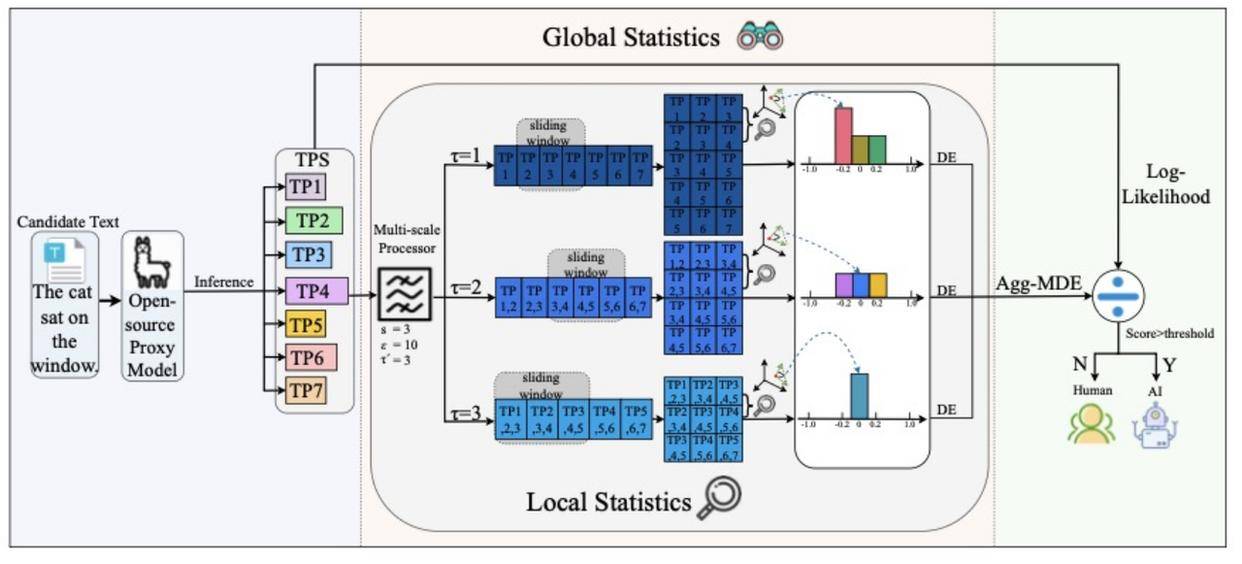

“我们提出了一种无需训练即可检测AI合成文本的方法。★”王永威告诉记者★,他们通过单词预测的概率分布判断文章是否由AI生成,其准确率超过美国商用文本检测模型GPTZero 近6个百分点,并支持跨语种检测,这一成果已被人工智能顶级学术会议ICLR 2025录用。而在AI合成图像检测方面,该团队研发的六个专家模型,能够综合多个维度的检测特征,能对当前流行的近20种生成模型进行鉴伪★,准确率达到92%,处于世界领先水平。

刘健告诉记者,蚂蚁集团通过举办比赛推动技术进步★,比如2024年外滩大会首次举办的★“全球Deepfake(深度伪造)攻防挑战赛”,吸引了全球2200多名参赛者。令人鼓舞的是,比赛中,中科院一支队伍开源了其获奖作品“Deepfake检测模型★”★,获得了澳门大学、中国海洋大学等近百名选手及所在队伍响应,接力开源代码★,共同援助受害者,守护真实世界。

此外,除了不断迭代技术应对攻击,蚂蚁集团还通过坚持“你敢付我敢赔”的承诺★,兜底用户损失★,以重塑用户对数字安全的信心。

例如源头的AIGC服务商需强化内容把控,利用水印等技术手段实现内容的可追溯性★;社交平台则需承担起内容核实与筛查的责任★,阻断虚假信息的流通渠道;同时,权威机构与国际组织可携手建立信息可信联盟★,确保鉴定与举证过程的透明与高效。

宇视科技近些年在AIoT智能物联领域取得了不少研发突破★。该公司云智能及业软产品部部长陶沁沁向我们揭示了AI伪造的新趋势:从数字领域悄然渗透至物理世界。有犯罪分子利用线D结构模型,制作成人脸头套,用于非法解锁和诈骗。为应对这一挑战★,宇视科技开发了3D结构光技术,通过大模型训练★,确保只有本人活体才能通过识别。

★“AI攻防就像★‘矛和盾★’,是一个持续博弈的循环过程。”刘健认为★,由于技术发展存在局限性和周期性,难免会遇到★“魔高一丈”防御失灵所产生的损失,就亟需构建一个超越单纯技术层面的★,涵盖监管★、法律★、制度及教育等多维度的综合性社会防护网★,携手共筑AI安全的坚固防线。

★“假新闻并非新生事物★,但AI大模型的崛起无疑大幅降低了造假的门槛★。★”浙江大学百人计划研究员★、博导王永威告诉记者★,深度伪造技术(Deepfake)在全球范围内引发了广泛关注★。借助人工智能深度学习的力量★,该技术能轻松合成逼真的图片★、视频与声音★,实现换脸、视频无缝合成及语音精准模拟★,创造出令人难辨真伪的内容。

蚂蚁集团AI核身安全团队采取三大策略★,来应对AI深度伪造挑战——不变应万变、交互逻辑以及持续监测。★“不变应万变就是通过AI防伪大模型识别真实世界中的共性,异常即判别伪造★;交互逻辑是指通过随机实时交互增加造假难度,例如高风险场景中的AI实时视频电话进行验证;持续监测则是实时监控异常行为,及时阻止造假★。” 刘健解释,为此,蚂蚁集团也研发推出了以安全防伪大模型为基础的新一代AI核身平台,包含AI鉴真的光鉴等产品。

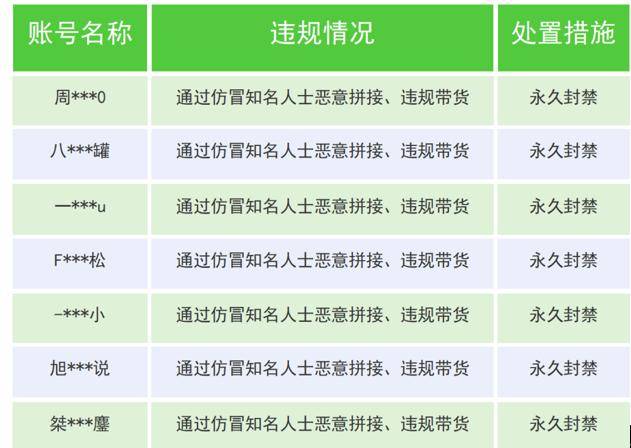

令人鼓舞的是,从政府到平台,一系列积极举措正逐步展开并持续优化。例如我国2023年实施的《互联网信息服务深度合成规定》★,明确要求深度合成服务提供者履行安全评估及配合检查的责任。微信等平台也积极响应,通过打击AI仿冒名人营销等行动,展现了维护网络清朗空间的决心与成效。

★“我们的摄像头配备AI大模型,经过多轮优化训练,在计算机视觉领域表现出色,能识别真人面部轮廓变化,结合多种验证手段★,确保精准判断。”陶沁沁表示。

如今,只需与AI智能助手进行简短对话★,几秒钟内便能生成一篇图文并茂的假新闻。

从灾难现场的虚假图片到名人仿冒事件★,AI发展这把双刃剑★,让“眼见为实★”这一固有信念遭受前所未有的挑战★。AI伪造如何产生?冲击有多大★?我们该如何守护真实的边界?

一封署名英伟达CEO黄仁勋的内部信表达对DeepSeek的看法;另一封“来自”DeepSeek CEO 梁文锋对冯骥的公开回应。

1月份,美国加利福尼亚州洛杉矶多地连续发生山火,★“在加州山火中幸存的教堂”图片、“好莱坞巨型标志牌被加州山火吞没”视频等在社交媒体上广泛流传,均检测出是人工智能生成或深度伪造的内容。

“公众对于AI虚假内容的辨别能力同样不容忽视。”王永威强育在防范AI伪造中的重要性,认为公众需了解基本概念和鉴伪方法★。他透露,团队正筹备实验室★,通过科普AI伪造技术和案例★,提升公众认知与防范意识,教会大众识别常见手法,培养警惕心理,减少虚假信息传播★。

乍一看信件文采斐然,自带人文情怀,还挺像那么回事★。幸好辟谣及时来到,明确说明信件完全是虚假捏造。

“AI伪造给社会带来最严峻的挑战,我认为是信任体系的崩塌。”刘健分析★,就像那则“狼来了”的经典寓言,面对大量虚假的信息,我们或许会因为难以分辨真伪,而逐渐变得麻木,它有可能悄然侵蚀人类社会的温情与关怀。尤其对于互联网原住民来说,数字世界里★,还能相信什么★?

据澎湃新闻报道,浙江绍兴警方曾抓获一个利用ChatGPT制作虚假新闻的团伙,其中就有此前从未接触过电脑技术、仅有初中学历的成员。正是凭借易上手的AI大模型,这名成员无需学会“脚本”“拍摄”“配音”★,就能像流水线一样批量生成一堆AI假新闻。

当算法裹挟着这些“情绪饱满★”的肉眼难辨的假新闻定向推送到你我面前时,大多数人往往被情绪所左右★,不假思索地点赞★、转发,不经意间成为谣言传播的帮凶。

上一条: 潮声丨AI伪造泛滥真实何去何从?

下一条: 潮声丨AI伪造泛滥真实何去何从?

relevant news

相关资讯

成都尊龙人生就是博中国区,尊龙凯时人生就搏,尊龙凯时·(中国区)人生就是搏!精密工具制造有限公司

地址:四川省成都市成华区龙潭都市集中工业区成佳路2号

成都尊龙人生就是博中国区,尊龙凯时人生就搏,尊龙凯时·(中国区)人生就是搏!银虎数控刀具有限公司

地址:成都市青白江区欧洲产业城欧城中路55号